Special 인공지능 컴퓨팅을 위한 소재 및 소자기술 개발 동향(1)

뉴로모픽 반도체와 광전자 시냅스 소자 연구

강동호_광주과학기술원 반도체공학과 조교수

1. 서론: 인공지능의 역사

우리에게 ‘인공지능(Altificial Intelligence; AI)’이라는 단어는 언제부터 일상적인 개념이 되었을까? 그 시점은 사람마다 다르겠지만, 많은 이들에게는 2016년 구글 딥마인드(Google Deepmind)의 알파고(AlphaGo)와 우리나라의 이세돌 九단이 맞붙었던 바둑 대국이 하나의 기점으로 기억될 것이다. 기존에는 바둑에서 놓을 수 있는 경우의 수가 우주에 존재하는 모든 원자의 수보다 많다고 알려질 정도로, 인간의 직관과 경험을 컴퓨터의 계산력이 따라갈 수 없다고 여겨져 왔다. 그러나 이 대국은 인공지능이 단순한 계산 기기를 넘어, 전략과 판단의 영역에서도 인간을 능가할 수 있음을 전 세계에 분명히 보여준 사건이었다.

하지만 서구 사회에서 인공지능의 잠재력이 주목받기 시작한 시점은 그보다 훨씬 앞선다. 1997년, IBM의 딥블루(Deep Blue)는 당시 체스 세계 챔피언이었던 가리 카스파로프(Garri Kasparov)와의 체스 대국에서 3½–2½로 승리를 거두며, 인공지능의 가능성을 처음으로 대중 앞에 선보였다. 이후 2011년에는 IBM이 개발한 인공지능 왓슨(Watson)이 미국의 유명 퀴즈쇼 제퍼디!(Jeopardy!)에 출연해 인간 참가자들을 제치고 우승하며 다시 한 번 큰 화제를 모았다. 특히 왓슨은 미리 정의된 규칙을 따라 움직이던 기존 인공지능과 달리, 방대한 텍스트 자료를 기계학습(Machine Learning)을 통해 학습하고 정답에 도달할 확률을 계산하는 방식으로 작동했다는 점에서 딥블루와 뚜렷한 차이를 보였다.

|  |  |

그림 1. (좌) IBM 딥블루와 가리 카스파로프의 체스 대국, (중) IBM 왓슨의 제퍼디! 출연, (우) 구글 딥마인드 알파고와 이세돌 九단의 바둑 대국 (소스: IBM, Google)

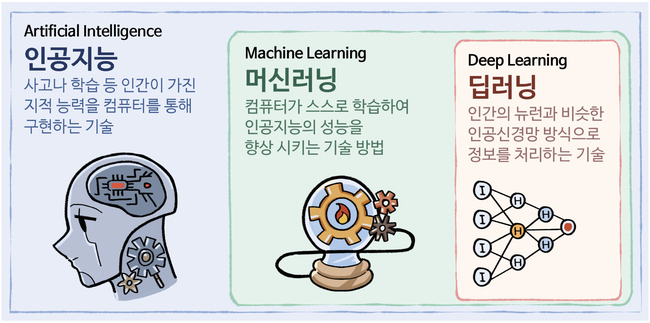

인공지능은 본래 컴퓨터가 ‘사람처럼 생각하고 판단’하도록 만드는 기술을 의미한다 (그림2). 이 정의에 비추어 보면, 당시 딥블루는 체스 세계 챔피언에게 승리를 거둘 정도로 체스를 ‘학습’한 인공지능으로 여겨졌었지만, 미리 설계된 규칙과 알고리즘을 바탕으로 사람보다 더 높은 연산 능력을 보인 계산 기계라 할 수 있었다. 이는 지능보다는 연산 능력이 핵심이었던 1차 AI 붐을 대표하는 전통적 인공지능의 전형이다. 반면 왓슨은 사회자가 말(Language)로써 제시하는 문제를 받아들이고, 말 속에 함의된 맥락과 중의성을 고려하여 가장 가까운 답을 선택하는 방식은 딥블루보다 훨씬 ‘사람처럼 생각하고 판단’하는 것에 가까웠다. 이는 기계학습을 중심으로 전개된 2차 AI 붐의 성격과도 맞닿아 있다. 마지막으로 알파고는 한 단계 더 나아가, 인간이 규칙이나 정답을 일일이 제공하지 않아도 스스로 바둑 대국을 반복하며 전략을 학습하는 딥러닝(Deep Learning) 기술을 통해 사람보다 더 뛰어난 판단의 기준 자체를 형성할 수 있음을 입증했다. 결국 우리가 목격한 알파고와 이세돌 九단의 바둑 대국은 딥러닝을 중심으로 한 3차 AI 붐의 시작인 셈이다.

그림 2. 인공지능의 정의 (소스: 교육부 국립특수교육원)

2. 딥러닝과 AI 반도체

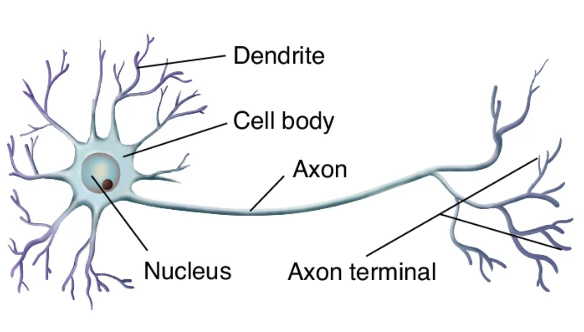

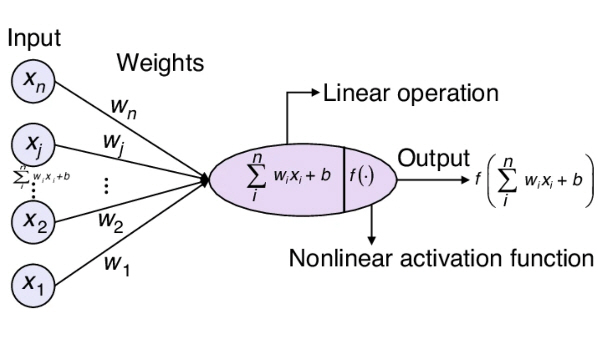

그렇다면 알파고를 가능하게 만든 딥러닝이란 무엇인가. 딥러닝의 정의는 ‘인간의 신경망을 모방한 인공신경망을 통해 기계가 사람처럼 생각할 수 있도록 만드는 기술’이다 (출처: 교육부 국립특수교육원). 이를 명확하게 이해하기 위해서는, 그림 3과 같이 인간의 신경세포 구조와 수학적으로 모델링한 인공 뉴런을 대응하여야 한다. 인간의 뉴런(그림 3좌)에서 가지처럼 뻗은 수상돌기(dendrite)는 외부로부터 신호를 받아들이는 역할을 하고, 이 신호들은 세포체(cell body)에 모여 축삭돌기(axon)를 따라 다음 뉴런으로 전달된다. 이 때, 뉴런과 뉴런 사이에는 시냅스(Synapse)라 하는 미세한 접합 구조가 존재하는데, 뉴런 간 정보 전달의 방향성과 강도를 조절하는 역할을 한다. 사람의 뇌는 이러한 뉴런과 시냅스의 연결이 매우 복잡하게 이루어져 신경망(Neural Network)을 이룬다. 이를 모방한 인공신경망(Artificial Neural Network)에서는 이와 같은 과정을 모사하는 데에 중점을 둔다. 그림 3우와 같이 여러 개의 시냅스 전 뉴런이 하나의 시냅스 후 뉴런으로 모이는 경우를 가정하면, 여러 개의 입력값은 각 시냅스에서 정해진 가중치(weight)가 곱해진 상태로 다음 뉴런으로 모이며, 이 과정은 선형 연산으로 표현된다. 다시 말해, 각 입력 신호의 중요도를 반영한 가중 합이 계산되는 것이다. 이는 생물학적 신경망에서 여러 뉴런에서 발생한 신호가 동시에 다음 뉴런으로 유입되어 통합되는 과정을 모사한 것이다[1].

|  |

그림 3. (좌) 생물학적 뉴런의 구조, (우) 수학적으로 모델링한 뉴런의 구조[1]

그러나 뉴런의 역할은 단순히 정보를 모으고 전달하는 것에 그치지 않는다. 생물학적 뉴런은 이전 단계에서 전달받은 신호를 축적하다 일정 임계 조건에 도달해야만 신호를 발화하면서 다음 뉴런으로 신호를 전달한다. 이러한 과정을 수학적으로 모델링한 뉴런 구조에서도 모사하기 위해 차용한 것이 비선형 활성화 함수(Nonlinear Activation Function)다. 이 비선형 활성화 함수의 추가를 통해, 인공신경망에서는 단순한 계산의 반복이 아닌 보다 복잡한 패턴(이미지, 소리와 같은 비정형 데이터)을 효과적으로 학습하고 판단할 수 있다. 특히 이 신경망의 연결이 복잡해질수록, 입력에서 출력으로 이어지는 과정은 단계적인 판단의 누적으로 이루어진다. 초기 단계에서는 비교적 단순한 정보가 처리되고, 이후 단계가 깊어질수록(deep) 보다 추상적이고 복잡한 패턴까지 학습(learning)할 수 있어, 이를 통틀어 딥러닝(deep learning)이라 부르는 이유이다.

문제는 패턴이 복잡한 데이터의 처리요구량이 증가할수록, 학습에 필요로 하는 인공신경망의 복잡도가 증가하게 되고 이로 인해 인공 뉴런에서 발생하는 연산량이 기하급수적으로 늘어난다는 점이다. 흑백의 단순한 숫자 이미지를 처리하는 데에는 3층의 인공 신경망으로도 충분하나, 실시간으로 변하는 고해상도 컬러 비디오 데이터를 처리하기 위해서는 수 배 이상의 복잡한 인공신경망이 필요하며, 이는 필연적으로 연산속도의 하락 및 전력 소모의 상승을 야기한다. 현재는 이러한 문제를 해결하기 위해 맞춤형 AI 반도체의 개발이 요구되고 있다.

-----이하 생략

<본 기사는 일부 내용이 생략되었습니다. 자세한 내용은 세라믹코리아 2026년 2월호를 참조바랍니다. 정기구독하시면 지난호보기에서 PDF 전체를 열람하실 수 있습니다.>

기사를 사용하실 때는 아래 고유 링크 주소를 출처로 사용해주세요.

https://www.cerazine.net